Los números romanos

Los números romanos son un sistema de numeración que se originó en la Antigua Roma y que utiliza siete letras mayúsculas del alfabeto latino para representar valores numéricos.

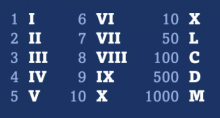

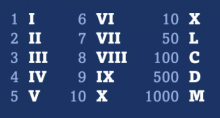

Cada letra tiene un valor fijo:

Los números romanos son un sistema de numeración que se originó en la Antigua Roma y que utiliza siete letras mayúsculas del alfabeto latino para representar valores numéricos.

Cada letra tiene un valor fijo:

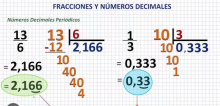

Para comparar fracciones y números decimales, el método más eficaz es convertirlos a la misma forma: ambos a fracciones o ambos a decimales.

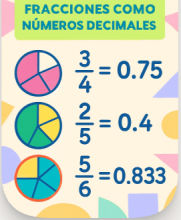

Convertir fracciones a decimales

El método más común es convertir la fracción a un decimal. Esto se logra dividiendo el numerador (el número de arriba) entre el denominador (el número de abajo).

Ejemplo:

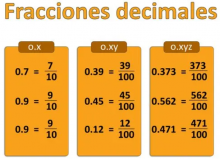

Los números decimales representan cantidades que no son enteras, como 0.5, 2.75 o 3.2. Aunque se escriben con punto decimal, también pueden expresarse como fracciones, lo que permite entender mejor su valor y realizar operaciones matemáticas más fácilmente.

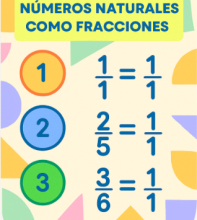

Los números naturales (1, 2, 3, 4, ...) son la base de la aritmética y se utilizan para contar objetos, ordenar elementos y representar cantidades enteras. Aunque suelen verse como números "completos", también pueden expresarse como fracciones, lo cual es útil para comprender mejores conceptos matemáticos como la división, la proporcionalidad y el valor relativo.

¿Cómo se expresa un número natural como fracción?

Todo número natural puede escribirse como una fracción colocando el número sobre el 1. Por ejemplo:

La expresión de fracciones como números decimales es la representación de una fracción, que es una parte de un todo, como un valor en el sistema numérico decimal que usamos a diario. El proceso se lleva a cabo al dividir el numerador de la fracción por el denominador.

Concepto y su importancia

Los números decimales con finitas o infinitas cifras son una forma de clasificar los números que tienen una parte decimal, es decir, cifras a la derecha del punto o la coma. Esta clasificación se basa en si las cifras decimales terminan o continúan para siempre.

Números decimales: un mundo de posibilidades

Las milésimas son la tercera cifra a la derecha del punto decimal en un número. Representan la milésima parte de una unidad, es decir, el resultado de dividir una unidad en 1000 partes iguales. Una milésima se puede expresar como la fracción 1/1000 o como el número decimal 0,001.

Importancia

Comprender las milésimas es crucial en matemáticas y en la vida cotidiana para poder representar y manejar cantidades extremadamente pequeñas. Su importancia radica en:

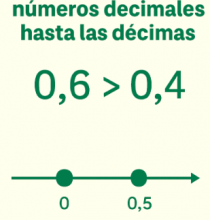

Los números decimales se comparan para determinar cuál es mayor, menor o si son iguales. Para los estudiantes de primaria, una de las mejores formas de entenderlo es visualizándolos en una recta numérica o siguiendo una serie de pasos lógicos.

Concepto y reglas de comparación

La forma más sencilla de entender la comparación de números decimales es recordar que el número que se encuentra más a la derecha en la recta numérica es el mayor.

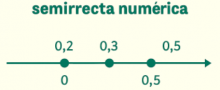

Los números decimales en la semirrecta numérica son una forma visual de representar y comparar números que no son enteros. La semirrecta numérica es una línea que empieza en un punto (generalmente el cero) y se extiende indefinidamente en una dirección. Para ubicar números decimales en ella, la dividimos en partes iguales.

¿Cómo se ubican?

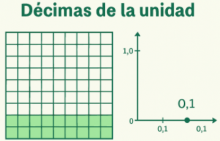

Las décimas son las partes que resultan de dividir una unidad en diez partes iguales. Una décima se puede representar como la fracción 1/10 o como el número decimal 0,1. Cada décima equivale a 0,1. Por ejemplo, siete veces 0,1 es 0,7.

Importancia y uso en la matemática para primaria

Aprender sobre las décimas es crucial en la educación primaria porque ayuda a los estudiantes a comprender los números decimales y cómo se relacionan con las fracciones. Este concepto es fundamental para: